Kanadyjskie Ministerstwo Imigracji, Uchodźców i Obywatelstwa (IRCC – Immigration, Refugees and Citizenship Canada) od kilku lat wdraża sztuczną inteligencję (AI) w procesach przetwarzania wniosków imigracyjnych, w tym tych o azyl polityczny, wizy tymczasowe, pozwolenia na pracę czy studia.

Jednocześnie wnioskodawcy coraz częściej korzystają z narzędzi AI, takich jak ChatGPT, do przygotowywania swoich podań. Ta sytuacja tworzy złożony problem, gdzie AI spotyka się z AI, prowadząc do błędów, braku transparencji, potencjalnych uprzedzeń i ludzkich tragedii.

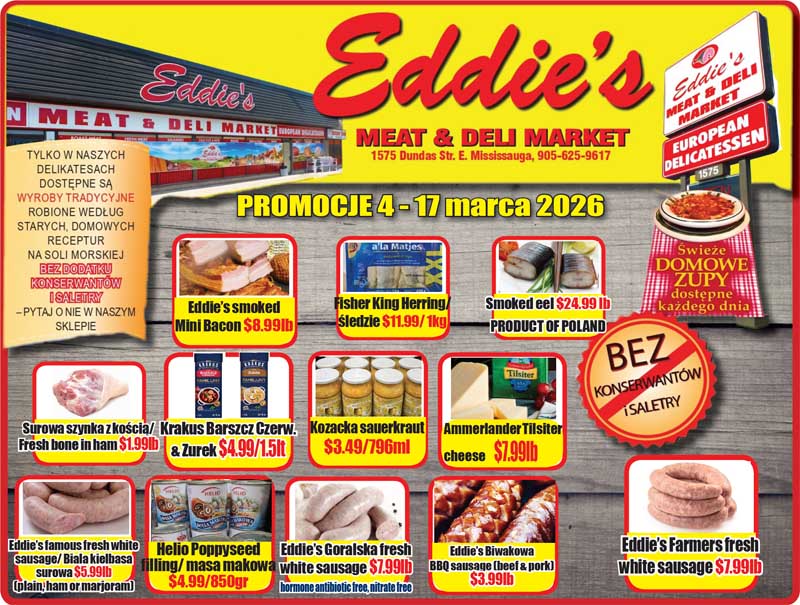

Osób ubiegających się o azyl w Kanadzie lub inne formy zezwoleń (np. wizy studenckie, pracownicze czy tymczasowe) często nie stać na prawników, więc sięgają po darmowe lub tanie narzędzia AI do pisania listów motywacyjnych, podań prawnych czy wyboru ścieżek imigracyjnych. AI pomaga w formułowaniu wniosków, ale generuje ryzyka: Halucynacje i błędy- AI może czasem wymyślać nieistniejące orzecznictwa sądowe lub przepisy prawa, co prowadzi do niewiarygodnych aplikacji.

W jednym przypadku 31 Kameruńczyków złożyło wnioski cytując to samo nieistniejące orzecznictwo, co zostało wykryte i zgłoszone przez media. Wnioskodawcy o azyl mogą używać AI do “ulepszania” swoich historii życiowych, co IRCC wykrywa jako fałszywe narracje, potencjalnie maskujące problemy bezpieczeństwa. W konsekwencji jeśli AI zostanie uznane za źródło fałszowania (misrepresentation), wnioskodawca może otrzymać zakaz wjazdu do Kanady na 5 lat lub dłużej. To szczególnie dotkliwe dla uchodźców, których wnioski o azyl wymagają autentycznych, osobistych historii – AI może je ujednolicać, czyniąc je podejrzanymi.

IRCC stosuje AI do radzenia sobie z ogromnymi zaległościami (ponad milion wniosków w grudniu 2025 r.) i opóźnieniami (ponad połowa decyzji o wizach i rezydencjach jest spóźniona). AI nie podejmuje ostatecznych decyzji (zwłaszcza odmownych), ale wspiera proces poprzez sortowanie wniosków na proste – niskiego ryzyka i złożone, podsumowywanie dokumentów, wykrywanie anomalii, dopasowywanie danych i rekomendacje dla urzędników. Narzędzia jak Chinook (oparte na Excelu) wizualizują dane z systemu zarządzania sprawami, przyspieszając przegląd.

I wykrywa też fałszywe narracje w wnioskach o azyl. We wnioskach o azyl dla uchodźców sponsorowanych prywatnie AI pomaga w automatyzacji pozytywnych decyzji kwalifikacyjnych. Dla wiz tymczasowych AI sortuje aplikacje z zagranicy. Jednak gdy AI spotyka AI, system staje się “czarną skrzynką” – brak pełnej transparencji co do algorytmów IRCC utrudnia zrozumienie, dlaczego wnioski są odrzucane. AI po stronie IRCC może pomijać niuanse ludzkie, prowadząc do arbitralnych odmów. Na przykład, autentyczne wnioski o azyl ze skomplikowanymi historiami mogą być wskazane jako podejrzane, jeśli AI wykryje wzorce podobne do generowanych przez boty.

W konsekwencji coraz więcej decyzji trafia do sądów federalnych, co zatyka system.

Problem polega na kolizji technologii. IRCC podkreśla, że AI jest narzędziem wspomagającym, a nie decyzyjnym, ale krytycy domagają się większej przejrzystości i ludzkiego nadzoru, by system imigracyjny Kanady pozostał wiarygodny i humanitarny.

.jpg)